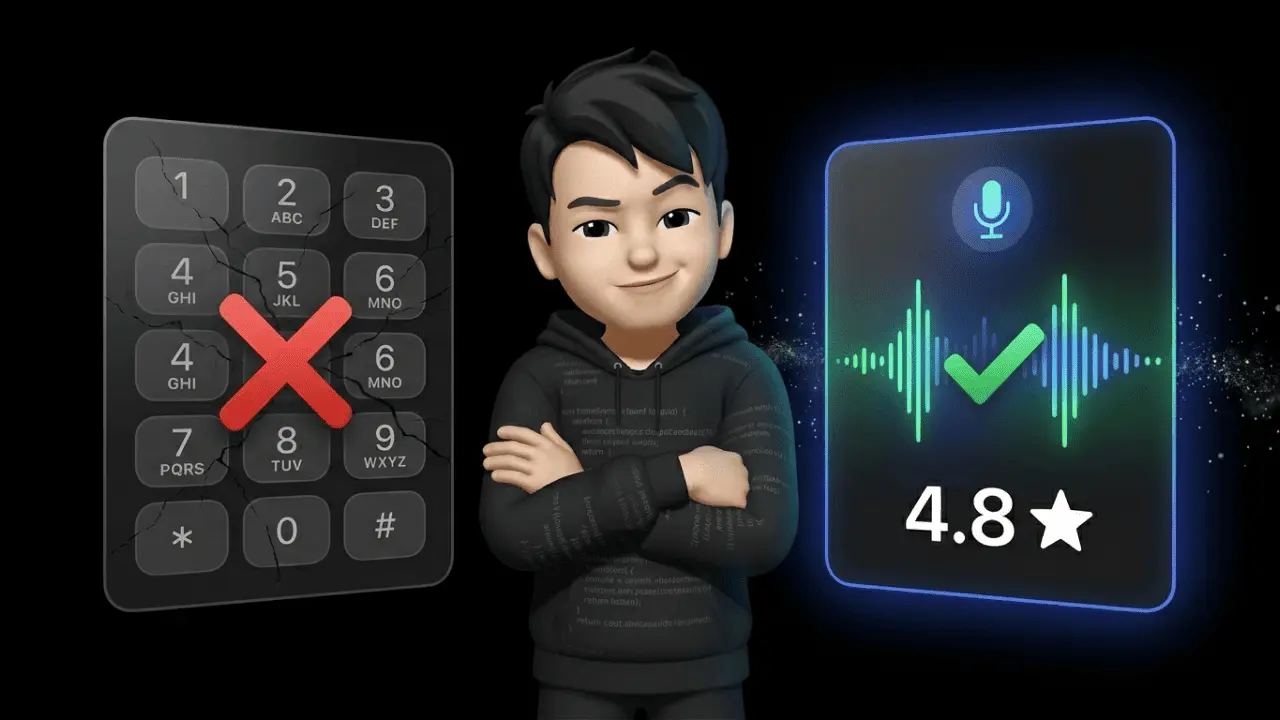

Dein Kunde ruft um 21:47 Uhr an. Er will wissen, wo sein Paket ist. 3 Minuten Warteschleife. Dann: "Drücken Sie die 1 für Sendungsverfolgung, die 2 für Retouren, die 3 für...". Er legt auf. Bestellung retour. Zwei Sterne bei Trustpilot.

AI Voice Agents lösen genau dieses Problem. Sie heben ab, verstehen "Wo ist mein Paket?" beim ersten Anlauf, ziehen die Tracking-Nummer aus deinem Shopify und antworten in unter einer Sekunde. Kein Menü. Keine Warteschleife. Kein Agent im 2nd Level.

Aber: Die Technologie ist nicht für jeden reif. Und für die meisten DACH-E-Commerce-Brands (noch) nicht der erste Hebel. Wer heute blind in Voice investiert, verbrennt Budget. Wer den Trend komplett ignoriert, verschläft den größten Umbruch im Kundenservice seit der Einführung des Call-Centers 1980.

Hier erfährst du, was 2026 wirklich geht – und wo Voice scheitert. Ohne Hype, mit Zahlen.

Was sind AI Voice Agents?

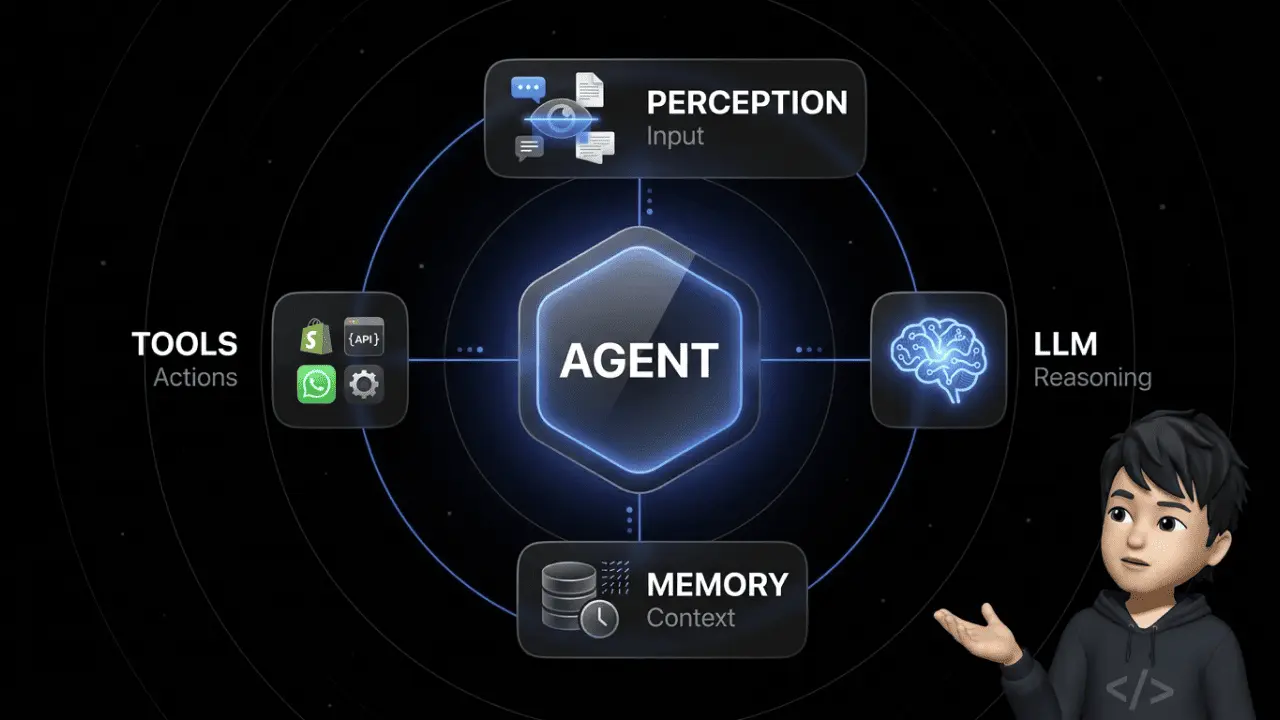

AI Voice Agents sind autonome Softwaresysteme, die in Echtzeit natürliche Telefongespräche mit Menschen führen. Sie erkennen gesprochene Sprache und verstehen den Intent des Anrufers. Sie greifen auf Unternehmensdaten zu und lösen Aufgaben ohne menschliches Eingreifen – von der Bestellstatus-Abfrage bis zur Lead-Qualifizierung.

Der Unterschied zum klassischen Chatbot ist das Medium: Voice statt Text. Der Unterschied zum klassischen IVR ("Drücken Sie die 1") ist die Intelligenz: Sprachverständnis statt Keyword-Matching. Der Unterschied zum menschlichen Agenten ist die Skalierung: 10.000 parallele Calls statt 100.

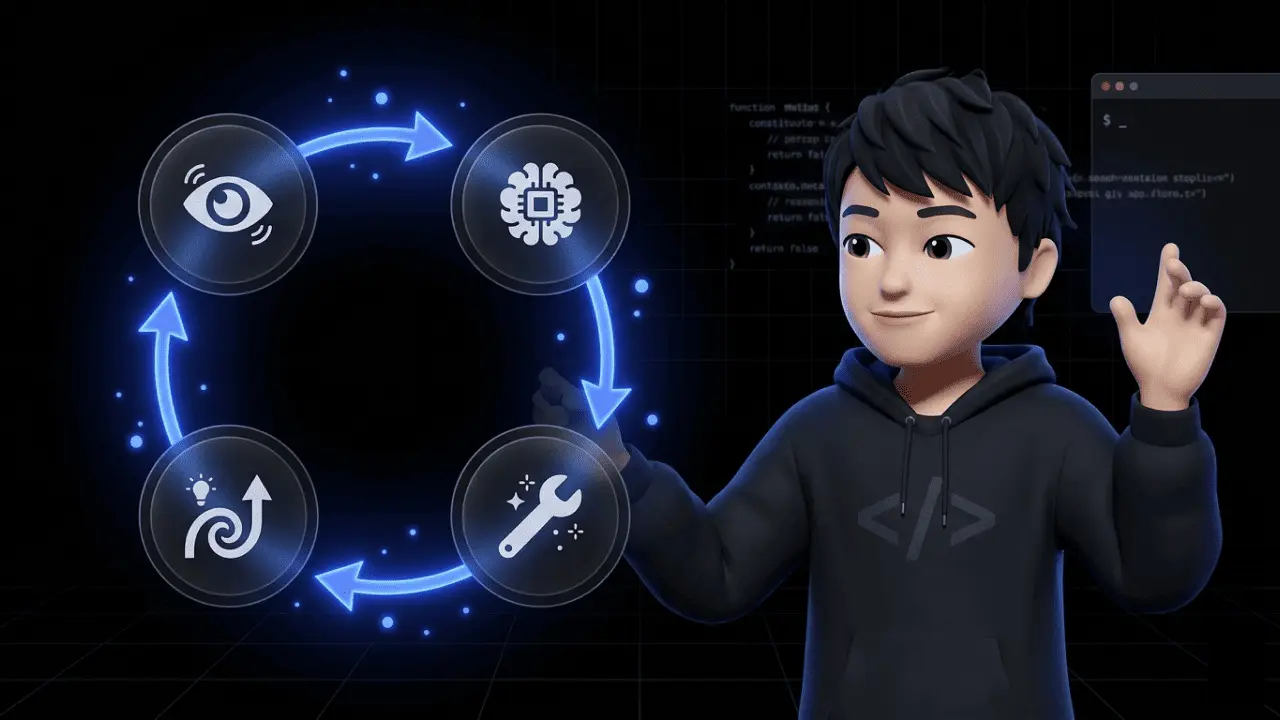

Konkret können moderne Voice Agents drei Dinge gleichzeitig:

- Zuhören – auch bei Akzent, Dialekt, Hintergrundgeräuschen

- Verstehen – auch bei halben Sätzen, Slang, Kontextwechseln mitten im Gespräch

- Handeln – Bestellungen stornieren, Termine buchen, Daten aus dem CRM abrufen, Tickets eskalieren

Der Markt dafür explodiert: Laut Market.us wächst der globale Voice-AI-Agents-Markt von 2,4 Mrd. USD (2024) auf 47,5 Mrd. USD bis 2034 – bei einer CAGR von 34,8 %. Gartner legt noch zwei Prognosen nach: Erstens, dass Conversational AI die Arbeitskosten in Contact Centern bis 2026 um rund 80 Mrd. USD (≈ 74 Mrd. EUR) senkt (Gartner Pressemitteilung, 2022). Zweitens, dass agentische KI bis 2029 rund 80 % der häufigsten Kundenservice-Fälle autonom löst.

Wer heute sagt "KI-Telefonate klingen doch immer noch roboterhaft", hat die letzten 12 Monate verschlafen. Der Beweis: Die meisten Menschen erkennen in Blind-Tests nicht mehr zuverlässig, ob sie mit einem Voice Agent oder einem Menschen sprechen – vorausgesetzt, das Setup stimmt.

Die Technologie dahinter: ASR, LLM und TTS

Ein AI Voice Agent besteht aus drei Kern-Komponenten, die über eine Orchestrierungsschicht in Echtzeit kommunizieren. Wenn eine davon schwach ist, fällt das gesamte Gespräch auseinander.

| Komponente | Funktion | Was sie entscheidet |

|---|---|---|

| ASR (Automatic Speech Recognition) | Wandelt Sprache in Text | Wie gut der Agent bei Akzent, Dialekt, Nebengeräuschen versteht |

| LLM (Large Language Model) | Versteht Intent, greift auf Daten zu, formuliert Antwort | Wie klug und kontextfest der Agent reagiert |

| TTS (Text-to-Speech) | Wandelt Antwort in Stimme zurück | Wie natürlich und emotional der Agent klingt |

Die Kette läuft so: Mikrofon → ASR wandelt gesprochenes Wort in Text → LLM interpretiert, nutzt RAG (Retrieval-Augmented Generation), um auf Shopify-Daten, Ticket-History oder Wissensdatenbank zuzugreifen → TTS wandelt die Antwort wieder in Sprache → Lautsprecher.

Zwischen jeder Station geht Zeit verloren. Und genau hier trennt sich Spreu von Weizen. Moderne Systeme streamen die einzelnen Schritte parallel, statt sie sequenziell abzuarbeiten. Heißt konkret: Während du noch redest, transkribiert die ASR schon das Bisherige und schickt es ans LLM.

Ohne diese Streaming-Architektur landest du bei Antwortzeiten von 2 bis 4 Sekunden – was im Telefonat tödlich ist. Dazu gleich mehr.

RAG ist der zweite entscheidende Teil. Ein Voice Agent ohne Zugriff auf dein CRM, deine Bestelldatenbank oder dein Retouren-Tool ist ein besserer Anrufbeantworter. Mit Zugriff wird er zum First-Level-Support.

Und der dritte oft unterschätzte Faktor: Hintergrundlärm. In echten Szenarien (Straße, Büro, Supermarkt) liegt das Lärmniveau zwischen 55 und 65 Dezibel. Ohne spezialisierte Noise-Cancellation-Modelle steigt die Word Error Rate der ASR dort um 15 bis 30 %. Anbieter wie Deepgram haben sich genau auf dieses Problem spezialisiert – und der Unterschied im Produktiveinsatz ist massiv.

Speech-to-Speech & Affective Computing: Die neue Generation

Bisher war jeder Voice Agent eine Staffel mit drei Läufern: Audio → ASR → LLM → TTS → Audio. Das heißt Cascading. Jede Übergabe kostet Zeit, jeder Schritt verliert Information (z. B. Tonfall, wenn Audio zu Text wird).

Die neue Generation macht Schluss damit. Speech-to-Speech-Modelle (End-to-End) verarbeiten Audio direkt zu Audio – ohne Umweg über Text. Das drückt die Latenz auf unter 400 Millisekunden und erhält Emotionen und Nuancen, die im Text-Schritt verloren gehen.

Beispiele: OpenAIs Realtime API, Googles Gemini Live, spezialisierte S2S-Modelle. Trade-off: Weniger Kontrolle über Zwischenergebnisse, schwierigeres Debugging, aufwändigere Integration. Cascading bleibt in den nächsten 12–18 Monaten der Standard für Enterprise-Setups.

Parallele Entwicklung: Affective Computing. Top-Systeme analysieren nicht nur was gesagt wird, sondern wie. Prosodie – Betonung, Rhythmus, Lautstärke, Pausen – verrät Frustration, Unsicherheit, Ungeduld. Die KI passt ihren eigenen Tonfall entsprechend an.

Konkret: Anruferin sagt "Wo ist mein verdammtes Paket?" → System erkennt Ärger an der Prosodie → Antworttonfall wird ruhiger, kürzer, empathischer. Das ist kein Gimmick – das verhindert Eskalationen.

Warnung: Das ist der Bereich mit den meisten Marketing-Übertreibungen. Nicht jeder, der "AI empathy" verspricht, hat echtes Affective Computing unter der Haube. Frag nach Prosodie-Metriken, sonst ist es Schall und Rauch.

AI Voice Agents vs. IVR: Warum "Drücken Sie die 1" stirbt

Klassisches IVR ist ein Dinosaurier. Es versteht nur, was du explizit programmiert hast. Sagt dein Kunde "Ich will meine Bestellung stornieren", aber dein Menü fragt nach der Bestellnummer-Eingabe via Tastatur – dann läuft das Gespräch ins Leere. Der Kunde drückt 0 und will zum Agenten.

Hier die drei harten Unterschiede:

| Kriterium | Klassisches IVR | AI Voice Agent |

|---|---|---|

| Eingabe | Zifferntasten oder feste Keywords | Freie Sprache, ganze Sätze |

| Kontext | Kein Gedächtnis innerhalb des Calls | Erinnert sich an alles im Gespräch |

| Unterbrechungen | System bricht ab oder ignoriert | Versteht Barge-ins, reagiert darauf |

| Themenwechsel | Menü zurücksetzen | Wechsel mitten im Satz möglich |

| Ton | Roboterhaft, starr | Natürlich, variierbar |

Barge-ins sind der unterschätzte Punkt. Menschen unterbrechen andere Menschen ständig – vor allem wenn klar ist, wohin das Gespräch läuft. Ein gutes Voice-Agent-System erkennt: "Aha, der Kunde redet schon wieder, also höre ich auf zu sprechen und höre zu."

Ein IVR kann das nicht. Es spult seine Ansage durch – und dein Kunde wird aggressiv.

Was das für E-Commerce bedeutet: Wenn du heute noch ein reines IVR-System betreibst und mehr als 1.000 Calls pro Monat bekommst, verbrennst du Customer Lifetime Value. Laut einer Vonage-Studie empfinden 61 % der Konsumenten klassische IVR-Menüs als schlechtes Kundenerlebnis. 63 % stört vor allem die Flut irrelevanter Optionen. Und 51 % haben schon Unternehmen komplett abgeschrieben, nachdem sie im IVR gelandet sind. Frustration, die direkt auf deine CSAT-Werte und Retention durchschlägt. Die Abbruchrate bei klassischen IVR-Setups liegt je nach Studie zwischen 20 und 35 %. AI Voice Agents kommen in sauberen Setups auf unter 10 %. Mehr dazu in unserem Pillar-Guide zu AI Agents.

Die 300-Millisekunden-Regel: Warum Latenz alles entscheidet

Jetzt wird's technisch – aber es lohnt sich. Diese eine Zahl entscheidet, ob dein Voice Agent ein echtes Gespräch führt oder wie ein Callcenter-Azubi am ersten Tag klingt.

Menschliche Reaktionszeit im Gespräch liegt bei 200 bis 300 Millisekunden. Schneller geht nicht, das ist Neurobiologie. Länger als eine halbe Sekunde merkst du unbewusst. Du wirst unsicher.

Die harten Schwellen:

- Unter 500 ms Latenz (End-to-End): Gespräch fühlt sich natürlich an. Das ist das Ziel.

- 500–800 ms: Noch vertretbar. Du merkst die Verzögerung, bist aber nicht gestresst.

- 800–1.000 ms: Stress beginnt. Der Anrufer fragt nach ("Hallo?"), wiederholt, redet drüber.

- Über 1.000 ms: Gespräch zerfällt. Interruptions häufen sich. Der Anrufer denkt, die Leitung ist tot.

Um Sub-500-ms zu erreichen, brauchst du Streaming-Architektur auf allen drei Ebenen – ASR, LLM, TTS. Kein System, das auf REST-Calls mit klassischer Request-Response wartet, schafft das.

Und: Die meisten sind nicht mal in der Nähe. Hamming AI hat über 4 Millionen Live-Calls ausgewertet. Der Industrie-Median: 1,4 bis 1,7 Sekunden Latenz. Fünfmal langsamer als die 300-ms-Erwartung. Der Abgrund zwischen Demo-Video und Realität.

Der unsichtbare Held: VAD (Voice Activity Detection). VAD erkennt anhand von Pausen, wann dein Kunde fertig gesprochen hat – und wann er nur kurz Luft holt. Gute Systeme unterscheiden "0,3 Sekunden = er überlegt noch" von "0,9 Sekunden = fertig, jetzt antworten". Schlechte VAD fällt dem Kunden ins Wort oder lässt 2 Sekunden Stille. Beides killt das Gespräch.

Heißt konkret: Wenn du einen Voice Agent auswählst, ist die erste Frage nicht "Was kann er?", sondern "Wie schnell antwortet er – und wie gut ist seine VAD?". Ohne Sub-800-ms und saubere Turn-Taking-Logik kannst du das Projekt beerdigen. Die guten Anbieter (Retell AI, Vapi, Deepgram) werben genau damit – weil sie wissen, dass Latenz die harte Währung ist.

Use Cases im E-Commerce: Wo Voice heute funktioniert

Für DACH-E-Commerce-Brands sind nicht alle Voice-Szenarien gleich relevant. Hier die drei Felder, wo der ROI heute am klarsten ist:

1. Inbound: Bestellstatus & Versandfragen Das Top-Ticket im E-Commerce. Rund 40 % aller Support-Anfragen in D2C-Shops drehen sich um "Wo ist mein Paket?". Ein Voice Agent mit Anbindung an DHL, Shopify und dein Tracking-System beantwortet das in 15 Sekunden – 24/7, ohne Warteschleife.

2. Inbound: Retouren-Abwicklung Kunde ruft an, nennt Bestellnummer, will zurückschicken. Der Agent generiert das Retourenlabel, sendet es per SMS oder E-Mail, fragt optional nach dem Retourengrund (wertvolle Daten). Fertig. Wenn dein Shop 500+ Retouren pro Monat hat, skaliert das sofort.

3. Outbound: Lead-Qualifizierung & Warenkorbabbruch Kunde legt einen 300-€-Warenkorb an und springt ab. Dein Voice Agent ruft innerhalb von 5 Minuten an, fragt konkret nach dem Grund (Versandkosten? Zahlungsart? Zweifel?) und bietet einen Gutschein an. Das ist in DACH rechtlich heikel (Double Opt-in!), aber in B2B-Kontexten stark.

Weitere Felder mit hohem Potenzial im E-Commerce:

- Terminbuchung bei Beratungsprodukten (Möbel, Fahrräder, Küchen)

- Post-Purchase-Feedback (NPS per Call statt Mail, deutlich höhere Rücklaufquote)

- Adressänderungen und Zahlungsreklamationen

- Rückrufservices bei Out-of-Stock-Produkten

- Abwicklung von B2B-Nachbestellungen (Großhandel, Gastronomie-Lieferanten)

Ein konkretes Szenario: Ein DACH-Möbelshop mit 40.000 Bestellungen/Jahr hatte 22 % Abbruchrate im Telefonsupport – meist wegen zu langer Warteschleifen. Ein Voice Agent für Bestellstatus und Liefertermine nahm 68 % der Calls vollautomatisch ab. Abbruchrate fiel auf 6 %. Die humanen Agenten bearbeiteten danach nur noch komplexe Fälle – und CSAT stieg parallel.

Faustregel: Wenn dein Ticket-Volumen über 3.000 Calls/Monat liegt und mindestens 50 % standardisierbar sind, rechnet sich ein Voice-Agent-Pilot meist innerhalb von 6 Monaten. Darunter: erstmal Chat-Automatisierung bauen (siehe unseren Vergleich der 10 besten AI Agent Tools 2026).

Branchen-Ausblick: Healthcare, Logistik, Finanzen

Voice Agents sind in anderen Branchen schon weiter als im E-Commerce – vor allem dort, wo Telefonie der dominante Kanal ist und Compliance ohnehin streng ist.

Healthcare: Terminbuchung, Rezept-Erneuerungen, klinische Triage. Der Hebel ist riesig: Praxen verlieren 20–30 % der Anrufer, weil niemand abhebt. Ein Voice Agent kappt das. Pflicht hier: HIPAA (USA) bzw. strenge DSGVO-Compliance in DACH.

Logistik: Sendungsverfolgung, Paketumleitung, Zustellfenster. Hier läuft Voice oft hybrid: Agent klärt Standardfragen, eskaliert komplexe Fälle.

Finanzen: Betrugserkennung, Rechnungsfragen, Kreditkartensperrung. Regulatorisch das anspruchsvollste Feld – SOC2, PCI-DSS, GDPR als Minimum. Anbieter wie Rasa oder Kore.ai spezialisieren sich hier, weil sie On-Premise-Deployment bieten.

Was DACH-E-Commerce daraus lernen kann: Compliance ist kein Nice-to-have. Wenn dein Voice Agent Bestelldaten, Adressen oder Zahlungsinfos verarbeitet, brauchst du einen DSGVO-konformen Anbieter mit EU-Hosting. US-Cloud-Only ist für sensible Daten ein rechtliches Risiko. Konkret heißt das: AVV nach Art. 28 DSGVO, Informationspflicht laut Art. 13 (der Kunde muss zu Call-Beginn erfahren, dass er mit einer KI spricht), und bei Aufzeichnungen eine Einwilligung nach §§ 201 StGB.

Dazu kommt der EU AI Act. Seit 2024 in Kraft, mit gestaffelten Fristen. Voice Agents fallen je nach Use Case unter "Hochrisiko-KI" – besonders wenn sie emotionale Zustände analysieren (Affective Computing!). Stimme ist außerdem ein biometrisches Merkmal. Keine Aufzeichnung darf ohne explizite Einwilligung fürs Modelltraining genutzt werden. Anbieter, die deine Call-Daten zum eigenen Training zweckentfremden, sind ein K.o.-Kriterium.

Für regulatorisch harte Branchen (Finance, Healthcare, Public Sector) ist On-Premise-Hosting oder zumindest dedizierte EU-Instanzen der einzige sichere Weg. Anbieter wie Rasa oder Kore.ai bieten das – US-SaaS-First-Player in der Regel nicht. Mehr dazu im Ratgeber Ist WhatsApp DSGVO-konform? — die DSGVO-Prinzipien gelten für Voice ebenso.

Die Lernkurve aus Healthcare und Finance zeigt klar: Erfolgsfaktor ist nicht die Stimme, sondern die saubere Integration in CRM, ERP und Wissensdatenbank – plus eine Compliance-Strategie, die vor dem Pilotprojekt steht, nicht danach.

Voice vs. Chat: Wann welcher Kanal gewinnt

Hier kommt die ehrliche Einordnung. Wir bei Chatarmin bauen beides: den KI-Chat-Agent armincx für Ticket-Automatisierung und den KI-Telefonassistent für Voice-Support. Nicht weil wir Cross-Sell brauchen — sondern weil die Kanäle unterschiedliche Jobs machen.

Wann Chat gewinnt:

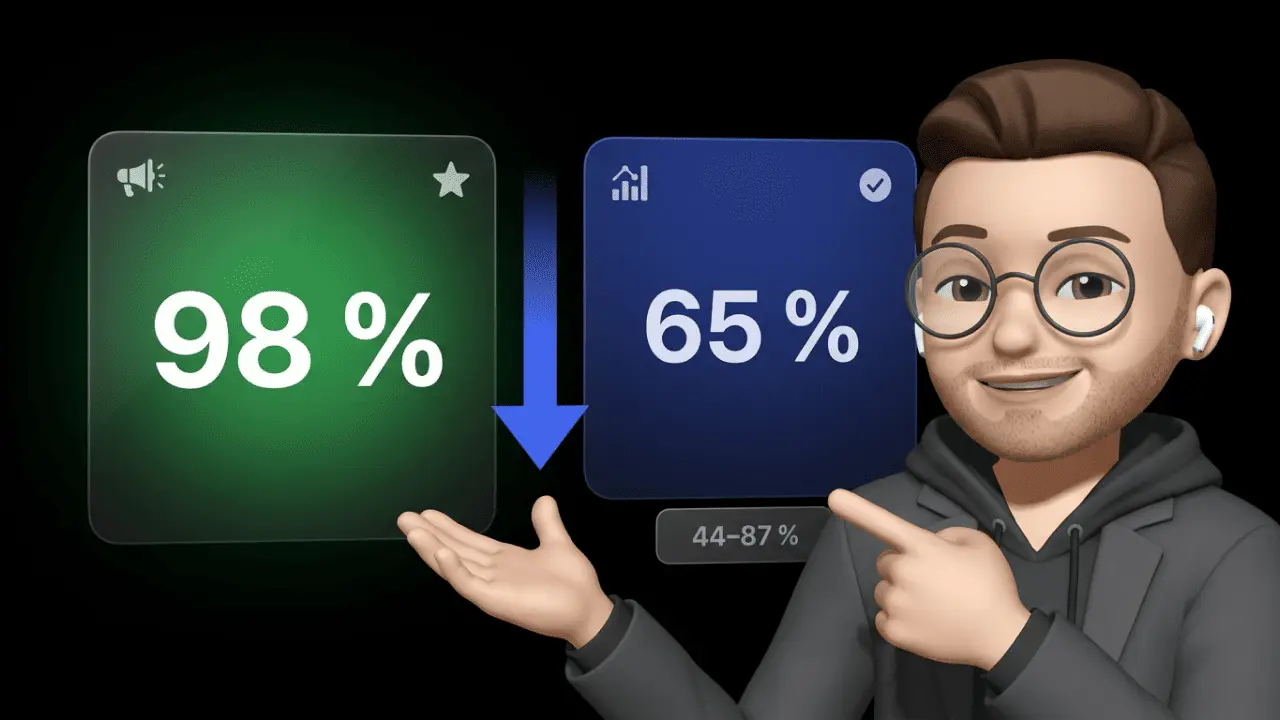

- Dein Kunde schreibt lieber. 56 % der Gen-Z- und Millennial-Käufer bevorzugen Text gegenüber Voice – nicht aus Faulheit, sondern weil Text Multitasking erlaubt.

- Outbound-Reichweite. WhatsApp hat ~85 % Open Rate. Ein Outbound-Call hat maximal 30 % Annahmequote.

- Cost per Resolved Ticket. Ein Chat-Agent nutzt nur den LLM-Teil. Ein Voice-Call frisst parallel ASR, LLM und TTS-Rechenzeit.

- Dokumentation. Chat ist schriftlich, Voice nicht. Für Nachvollziehbarkeit und Reklamationen gewinnt Chat.

Wann Voice gewinnt:

- Telefon ist der dominante Kanal deiner Zielgruppe – Senioren, Healthcare, klassische Beratungsprodukte.

- Komplexe Beratung mit Rückfragen – hier ist Voice 3-5× schneller als Chat-Ping-Pong.

- Premium-Support & Eskalationen – ein Anruf signalisiert Dringlichkeit, die ein Ticket nicht transportiert.

- Outbound-Flows, wo ein Call erwartet wird – z. B. Rückrufe nach Reklamationen oder Termin-Bestätigungen.

Der wahrscheinlichste Endzustand für DACH-E-Commerce: Hybrid. WhatsApp und Chat decken 70–80 % der Volumen ab. Voice übernimmt Eskalationen, Premium-Segmente und spezifische Outbound-Cases. Die meisten Brands sollten mit Chat-Automatisierung starten und Voice gezielt dazuschalten, sobald der Business-Case sitzt.

Unsere Position dazu: Wer heute Voice einführt, ohne vorher seine Chat-Tickets im Griff zu haben, baut zwei halbautomatisierte Kanäle statt einer funktionierenden Journey. Voice skaliert die Probleme, die du bei Chat noch nicht gelöst hast.

Führende Plattformen im Tech-Vergleich

Bevor wir auf die Anbieter gehen: Preise stehen hier nicht. Der Markt ist zu volatil, und ehrliche Einordnung geht nur über Technologie. Dazu kommt, dass jede Plattform je nach Volumen andere Konditionen fährt.

| Plattform | Stärke | Für wen |

|---|---|---|

| Retell AI | Extrem niedrige Latenz, Developer-First, Real-Time-Orchestrierung | Teams mit eigener Engineering-Power |

| Vapi | Skalierbare Infrastruktur für Millionen Calls, Omnichannel | Enterprise mit hohem Call-Volumen |

| ElevenLabs | Marktführer bei natürlichen, emotionalen AI-Stimmen (TTS) | Wenn Voice-Qualität Markenfaktor ist |

| Deepgram | Präziseste Spracherkennung selbst bei Callcenter-Lärm | Laute Umgebungen, harte Akzent-Anforderungen |

| Rasa / Kore.ai | Enterprise-Compliance, On-Premise möglich, tiefe Integrationen | Banken, Versicherungen, Healthcare, Public Sector |

Kernentscheidung: Willst du eine End-to-End-Plattform (Vapi, Retell) oder kombinierst du Best-of-Breed-Komponenten (ElevenLabs für TTS + Deepgram für ASR + eigenes LLM)? Option 1 ist schneller live, Option 2 bietet mehr Kontrolle.

Für DACH relevant: Prüfe Hosting-Region, Sub-Processor-Listen und DSGVO-AVV. Einige US-Anbieter bieten mittlerweile EU-Hosting, andere nicht. Das ist ein K.o.-Kriterium, kein Verhandlungspunkt.

Was du nicht bei diesen Tools findest: Tiefe E-Commerce-Integration in Shopify, Klaviyo, Gorgias. Dafür brauchst du entweder eigene Middleware oder eine spezialisierte Plattform, die diese Schnittstellen mitbringt. Die meisten Voice-Anbieter sind (noch) branchenagnostisch.

Häufig gestellte Fragen (FAQ) zu AI Voice Agents

Was ist ein AI Voice Agent?

Ein AI Voice Agent ist eine künstliche Intelligenz, die natürliche Telefongespräche mit Menschen führt, deren Anliegen versteht und Aufgaben wie Terminbuchungen oder Supportanfragen völlig autonom löst.

Wie hoch ist die Latenz bei modernen Voice Agents?

Die Latenz moderner AI Voice Agents liegt im Idealfall zwischen 300 und 500 Millisekunden. Reaktionszeiten unter dieser Schwelle nehmen Menschen als flüssiges, natürliches Gespräch wahr.

Können AI Voice Agents menschliche Callcenter-Mitarbeiter ersetzen?

Nein, sie ersetzen den Menschen nicht, sondern übernehmen den repetitiven First-Level-Support. Komplexe oder stark emotionale Fälle werden weiterhin nahtlos an menschliche Mitarbeiter eskaliert.

Was kostet ein AI Voice Agent?

Die Kosten setzen sich meist aus den API-Aufrufen für Spracherkennung, das KI-Modell und die Sprachsynthese zusammen. Abgerechnet wird im B2B-Umfeld typischerweise pro Gesprächsminute oder pro erfolgreich gelöstem Ticket.

Sind AI Voice Agents in Deutschland DSGVO-konform?

Ja, sofern der Anbieter lokales EU-Hosting anbietet, keine sensiblen biometrischen Stimmdaten zum KI-Training zweckentfremdet und ein Auftragsverarbeitungsvertrag (AVV) vorliegt.

Was ist der Unterschied zwischen einem Chatbot und einem Voice Agent?

Während ein Chatbot auf textbasierte Ein- und Ausgaben beschränkt ist, kommuniziert ein Voice Agent über gesprochene Sprache in Echtzeit und muss akustische Herausforderungen wie Akzente, Lärm und Unterbrechungen meistern.

Was bedeutet "Barge-in" bei KI-Sprachassistenten?

Barge-in ist die technische Fähigkeit eines Voice Agents, sofort aufzuhören zu sprechen und zuzuhören, sobald der menschliche Anrufer der KI mitten ins Wort fällt.

Welche Technologien stecken hinter Voice AI?

Ein klassischer AI Voice Agent kombiniert Automatic Speech Recognition (ASR) zum Hören, ein Large Language Model (LLM) zum Denken und Text-to-Speech (TTS) zum Sprechen.

Können KI-Telefonassistenten Emotionen erkennen?

Ja, modernste Systeme nutzen Affective Computing, um anhand von Stimmlage, Sprechtempo und Wortwahl Frustration zu erkennen und ihren eigenen Tonfall entsprechend empathisch anzupassen.

Welche Branchen profitieren am meisten von Voice AI?

Branchen mit hohem, standardisiertem Anrufvolumen wie E-Commerce (Bestellstatus), das Gesundheitswesen (Terminbuchung) und die Logistik profitieren durch sofortigen ROI am stärksten.

Fazit: Was du 2026 mit AI Voice Agents tun solltest

Voice Agents sind keine Zukunftstechnologie mehr. Sie sind produktiv im Einsatz, lösen echte Probleme und skalieren, wenn das Setup stimmt. Aber: Sie sind kein Plug-and-Play-Tool.

Meine ehrliche Empfehlung für DACH-E-Commerce-Brands:

- Unter 2.000 Calls/Monat: Kein dedizierter Voice Agent. Erst Chat-Automatisierung bauen — so automatisierst du den Kundenservice mit armincx.

- 2.000–10.000 Calls/Monat: Pilotprojekt lohnt sich. Ein klar abgegrenzter Use Case (z. B. Bestellstatus), 3 Monate testen, Abbruchrate messen.

- Über 10.000 Calls/Monat: Voice gehört in deine Roadmap. Latenz unter 800 ms fordern, Compliance klären, schrittweise ausrollen.

Der größte Fehler, den ich immer wieder sehe: Teams führen Voice Agents ein, ohne vorher ihre Wissensdatenbank und CRM-Integration sauber zu haben. Ergebnis: Agent klingt gut, liefert aber falsche Antworten. Das ist schlimmer als kein Agent. Garbage in, Garbage out – aber mit natürlicher Stimme, das macht es nochmal schlimmer.

Die wichtigste Wahrheit: Voice ist ein Kanal, keine Strategie. Die Brands, die 2026 gewinnen, denken in Customer Journeys – nicht in Touchpoints. WhatsApp für Newsletter und Outbound, Chat für Standardanfragen, Voice für Eskalationen und Premium-Support. Der Kanal ist Mittel, nicht Ziel.

Wer den Spielplan versteht, spart laut McKinsey 40–60 % Support-Kosten – ohne CSAT-Verlust. Der Rest steht nebendran und redet vom Hype.

Du willst sehen, wie KI-gestützter Kundenservice in der Praxis aussieht – über Chat UND Voice?

👉 Jetzt kostenlose Demo buchen – und schau dir an, wie armincx Tickets automatisch löst und der KI-Telefonassistent deine 2nd-Level-Warteschleife übernimmt.