Dein Chatbot beantwortet FAQs. Dein CRM speichert Kontakte. Dein Ticketing-System sortiert Anfragen in Ordner. Drei Tools, null Eigeninitiative. Autonomous ai agents ändern das grundlegend – sie erledigen Aufgaben, statt nur Informationen auszuspucken. Und genau dieser Unterschied entscheidet 2026 darüber, welche E-Commerce-Teams skalieren und welche in manuellen Prozessen stecken bleiben.

Der Markt für autonome KI-Agenten wächst laut Prognosen von 7,76 Mrd. USD (2025) auf fast 317 Mrd. USD bis 2035 – das entspricht einer jährlichen Wachstumsrate von 45 %. Das ist kein Hype-Zyklus. Das ist ein Infrastruktur-Shift.

Und die Ergebnisse sind bereits messbar: Laut dem Google Cloud Trend Report 2026 spart das Telekommunikationsunternehmen Telus durch den Einsatz von KI-Agenten 40 Minuten pro Kundeninteraktion. Der brasilianische Zellstoffhersteller Suzano hat die Bearbeitungszeit für Datenbankabfragen um 95 % reduziert. Das sind keine Laborwerte – das sind Produktionszahlen.

In diesem Artikel bekommst Du eine klare Definition, die technische Architektur dahinter und konkrete Einsatzgebiete für E-Commerce-Unternehmen im DACH-Raum. Kein Buzzword-Bingo, sondern Substanz.

Was sind autonomous ai agents?

Autonomous ai agents sind KI-Systeme, die ihre Umgebung eigenständig wahrnehmen, Ziele analysieren, Pläne erstellen und Handlungen ausführen – ohne dass ein Mensch jeden Schritt freigeben muss. Sie lernen kontinuierlich aus Feedback und passen ihr Verhalten an, statt nur auf Prompts zu reagieren. Der entscheidende Unterschied zu Chatbots: Agenten handeln, Chatbots antworten.

Vom Chat-Paradigma zum Do-Paradigma: Warum das jetzt relevant ist

Seit Ende 2022 kennt jeder generative KI. ChatGPT, Claude, Gemini – alles Tools, die auf einen Prompt warten und Text zurückgeben. Das ist das Chat-Paradigma: Du fragst, die KI antwortet.

Das Do-Paradigma funktioniert anders. Ein autonomer Agent bekommt ein Ziel – etwa „Bearbeite alle Retouren-Anfragen mit einem Warenwert unter 50 €" – und erledigt das selbstständig. Er prüft die Bestellung, gleicht die Rückgabebedingungen ab, erstellt das Retourenlabel und informiert den Kunden. Kein Mensch klickt dazwischen.

Das ist der größte Architektursprung seit der grafischen Benutzeroberfläche. Nicht weil die Modelle klüger geworden sind (das auch), sondern weil sie jetzt Werkzeuge bedienen können. Ein LLM, das eine API ansteuert, ist kein Chatbot mehr. Es ist ein Mitarbeiter mit Systemzugriff.

Für E-Commerce-Teams im DACH-Raum bedeutet das konkret: Prozesse, die bisher drei Tools und einen manuellen Handoff brauchten, laufen in einem Loop. Und bis Ende 2026 werden laut aktuellen Prognosen rund 40 % aller Enterprise-Anwendungen agentische KI integriert haben.

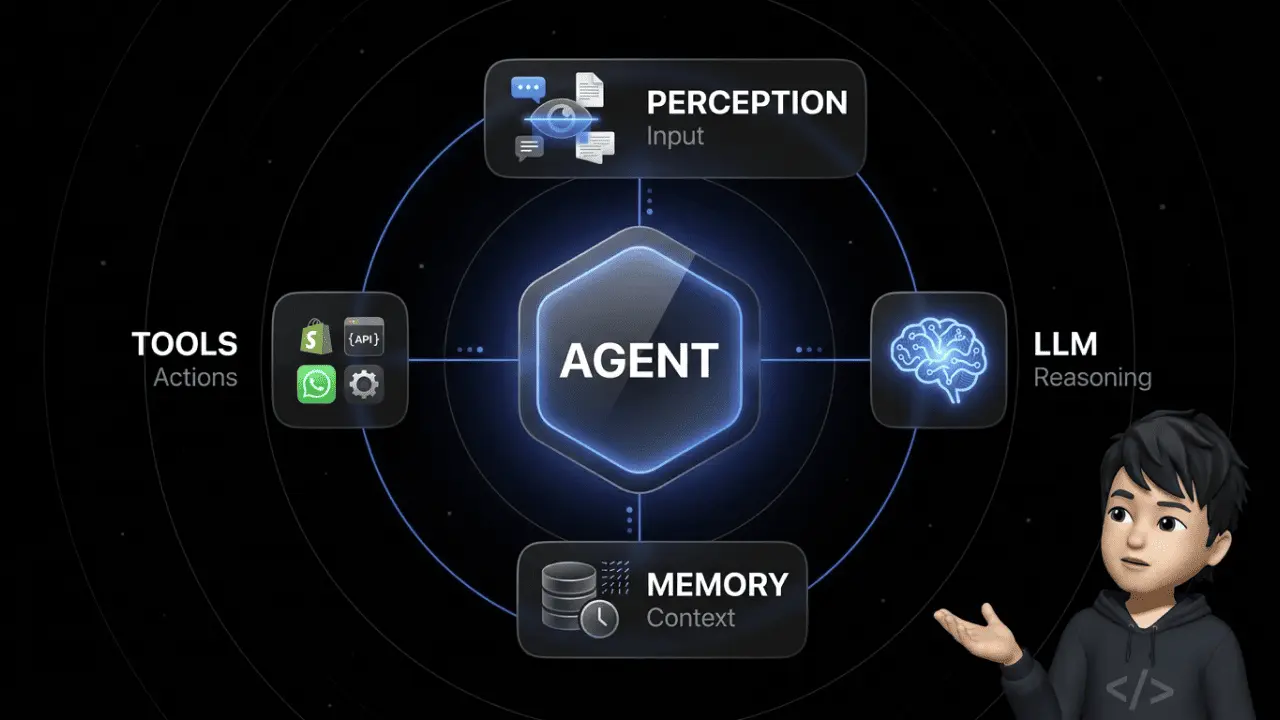

Die Architektur hinter autonomous ai agents

Damit ein Agent autonom arbeiten kann, braucht er vier Kernkomponenten. Kein Hexenwerk – aber wichtig zu verstehen, bevor Du einen einsetzt.

| Komponente | Funktion | Beispiel im E-Commerce |

|---|---|---|

| Perception | Umgebung wahrnehmen (Daten, Events, Nachrichten) | Eingehende WhatsApp-Nachricht mit Retourenfotos erkennen |

| Reasoning | Situation analysieren, Kontext verstehen | Bestellhistorie prüfen, Rückgabefrist berechnen |

| Planning | Handlungsschritte planen | Retoure genehmigen → Label erstellen → Kunde informieren |

| Action | Handlung ausführen | API-Call ans ERP, Nachricht via WhatsApp senden |

Das Gehirn: LLMs als Reasoning-Engine

Das Large Language Model übernimmt das Denken. Es interpretiert die Anfrage, wägt Optionen ab und entscheidet, welche Tools es braucht. Wichtig: Das LLM ist nicht der Agent – es ist eine Komponente des Agenten. Ein häufiges Missverständnis.

Orchestrierung: Wie Agenten ihre Aufgaben planen

Nicht jeder Agent plant gleich. Zwei Orchestrierungs-Muster dominieren 2026 – und welches Du wählst, beeinflusst direkt Kosten und Qualität.

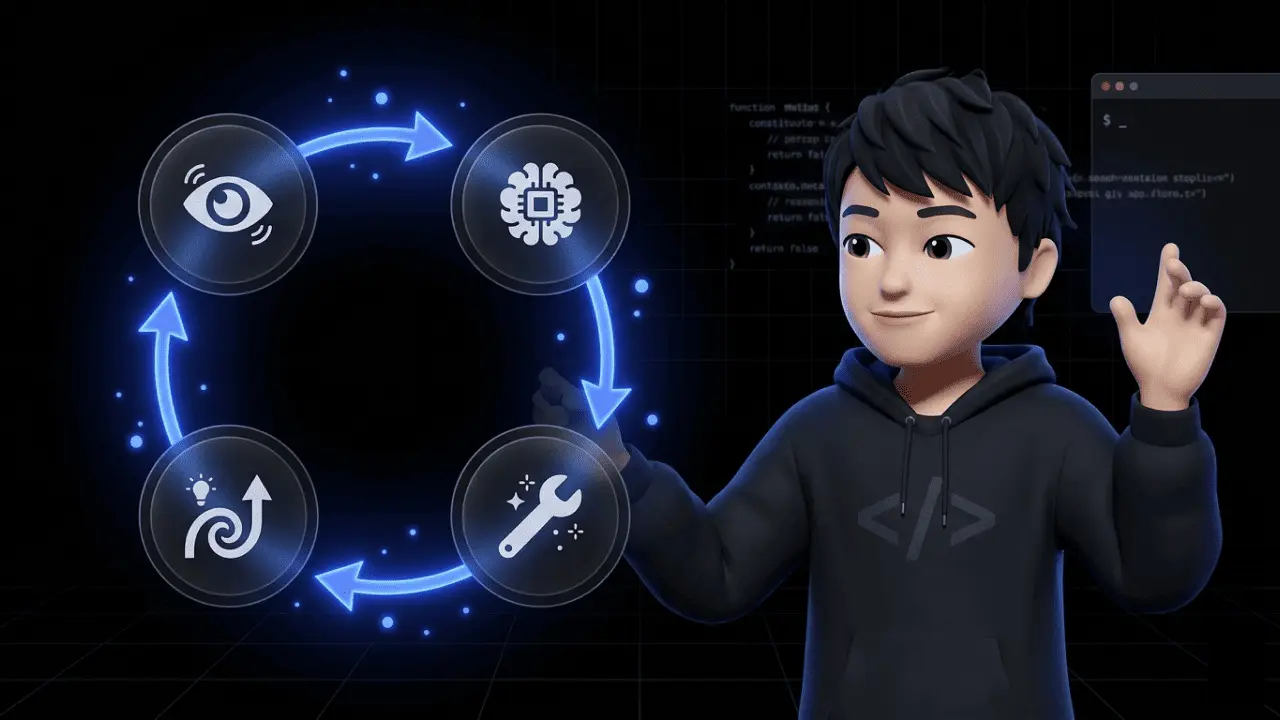

ReAct (Reason + Act): Der Agent beobachtet, denkt nach, handelt – und wiederholt diesen Zyklus iterativ. Bei jeder Iteration kann er seinen Plan anpassen. Ideal für dynamische Aufgaben, bei denen sich der Kontext während der Bearbeitung ändert. Der Nachteil: hoher Token-Verbrauch, weil das LLM bei jedem Schritt neu reasonen muss. Wenn Dein Agent eine offene Kundenbeschwerde bearbeitet, bei der er erst im Gespräch merkt, was das eigentliche Problem ist – ReAct.

Plan-and-Execute: Der Agent erstellt vorab einen kompletten Schritt-für-Schritt-Plan und arbeitet ihn dann sequenziell ab. Weniger Reasoning-Calls, weniger Token, niedrigere Kosten. Bei strukturierten Prozessen wie Retouren oder Order-Tracking die deutlich effizientere Wahl. Wenn der Ablauf vorhersehbar ist – Plan-and-Execute.

| Muster | Stärke | Schwäche | Bester Einsatz |

|---|---|---|---|

| ReAct | Flexibel, adaptiv | Hoher Token-Verbrauch | Offene Kundenanfragen, Troubleshooting |

| Plan-and-Execute | Kosteneffizient, schnell | Weniger flexibel bei Überraschungen | Retouren, Order-Tracking, KYC-Prüfungen |

In der Praxis kombinieren viele Systeme beide Muster: Plan-and-Execute für den Standardpfad, ReAct als Fallback, wenn der Plan nicht aufgeht.

Memory: Warum Agenten ein Gedächtnis brauchen

Ein Agent ohne Gedächtnis vergisst nach jeder Interaktion alles. Deshalb arbeiten moderne Architekturen mit drei Memory-Typen:

- Short-term Memory: Kontext der aktuellen Session. Der Agent weiß, dass der Kunde gerade über Bestellung #4821 spricht.

- Episodic Memory: Protokollierung aller Entscheidungen. Entscheidend für regulatorische Audits – gerade im DACH-Raum mit DSGVO kein Nice-to-have, sondern Pflicht.

- Long-term Memory: Erfahrungswerte in Vector-Datenbanken. Der Agent lernt, dass Kunden aus Österreich häufiger nach DPD-Retouren fragen als nach DHL.

Tools & Integrationen

Agenten werden erst durch Werkzeuge autonom. Sie sprechen APIs an, rufen Datenbanken ab, steuern externe Systeme. Zwei Protokolle treiben diese Entwicklung 2026:

MCP (Model Context Protocol): Verbindet Agenten standardisiert mit Tools – von Shopify über Zendesk bis zum eigenen ERP.

A2A (Agent2Agent): Das neue Protokoll (unter anderem von Google unterstützt) ermöglicht es Agenten verschiedener Hersteller, miteinander zu kommunizieren. Technisch funktioniert das über Agent Cards – JSON-basierte „digitale Visitenkarten", über die ein Agent seine Fähigkeiten im Netzwerk veröffentlicht. Dein Support-Agent braucht eine Retourenabwicklung? Er durchsucht die verfügbaren Agent Cards, findet den Logistik-Agent mit der passenden Capability und delegiert die Teilaufgabe. Kein Custom-Code, keine manuelle Integration. Agenten finden und beauftragen sich gegenseitig – wie Freelancer auf einer Plattform, nur in Millisekunden.

Einsatzgebiete im E-Commerce: Wo autonomous ai agents Ressourcen sparen

Keine Theorie mehr. Das sind die Use Cases, die für E-Commerce-Unternehmen im DACH-Raum den größten Hebel bieten.

Customer Support ohne Ticket-Pingpong

Der klassische Chatbot erkennt „Wo ist mein Paket?" und verlinkt auf die Tracking-Seite. Ein autonomer Agent löst das Problem: Er ruft die Tracking-API ab, erkennt eine Verzögerung, prüft ob eine Ersatzlieferung möglich ist und bietet dem Kunden eine konkrete Lösung an – alles in einer Interaktion.

Die Zahlen dazu: Der Anthropic Economic Index 2026 zeigt, dass Aufgaben von Kundenservice-Mitarbeitern heute bereits zu 67 % durch Agenten automatisiert abgedeckt werden können. Das ist kein Zukunftsszenario – das ist die gemessene „Observed Exposure" für Support-Rollen. Unternehmen, die vergleichbare Systeme einsetzen (etwa über Salesforce Agentforce), berichten von bis zu 70 % automatisierter Ticket-Bearbeitung.

Zwei Drittel der Support-Arbeit sind also bereits „agentenfähig". Die Frage ist nicht mehr ob, sondern wie schnell Dein Team das umsetzt.

Retouren-Management

Retouren kosten DACH-E-Commerce-Unternehmen Milliarden. Ein autonomer Agent nimmt die Anfrage an, validiert den Retourengrund anhand von Fotos (Perception), prüft die Policy (Reasoning), entscheidet über Genehmigung (Planning) und erstellt das Label (Action). Der gesamte Prozess läuft ohne manuellen Eingriff – bei klaren Fällen. Edge Cases werden automatisch an einen Menschen eskaliert.

Lead-Qualifizierung & Sales-Support

Im B2B-E-Commerce qualifizieren autonome Agenten eingehende Leads über WhatsApp oder Chat. Sie stellen die richtigen Fragen, gleichen Antworten mit dem CRM ab und übergeben nur qualifizierte Leads ans Sales-Team. Kein manuelles Lead-Scoring mehr, keine verlorenen Anfragen am Wochenende.

Computer-Using Agents: Wenn APIs nicht reichen

Nicht jedes System hat eine API. Manche Legacy-Software im DACH-E-Commerce hat Oberflächen aus 2008 und genau null Schnittstellen. Hier kommen Computer-Using Agents (CUA) ins Spiel.

Tools wie OpenAI Operator nutzen eine CUA-Architektur: Der Agent liest den Bildschirm visuell, bewegt eine virtuelle Maus und tippt auf einer virtuellen Tastatur – genau wie ein Mensch. Er navigiert durch Web-Oberflächen, füllt Formulare aus und klickt Buttons. Keine API nötig.

Für E-Commerce-Teams mit gewachsener Systemlandschaft ist das relevant: Dein Agent kann Bestellungen im alten ERP anlegen, ohne dass die IT erst eine API bauen muss. Der Agent bedient die Software so, wie Dein Team es heute manuell tut. Nicht elegant, aber extrem pragmatisch – und oft der schnellste Weg zur Automatisierung.

Sicherheit & Risiken: Die ehrliche Einordnung

Wer autonomous ai agents einsetzt, gibt Software Systemzugriff. Das muss man sich klarmachen, bevor man euphorisch wird.

Das größte Risiko: Prompt Injection

Ein Angreifer versteckt Befehle in einer E-Mail, einem Dokument oder einer Nachricht, die der Agent verarbeitet. Der Agent führt diese Befehle aus, weil er sie nicht von legitimen Instruktionen unterscheiden kann. Im schlimmsten Fall wird er zum „Confused Deputy" – ein System mit Zugriffsrechten, das im Auftrag eines Angreifers handelt.

Das ist nicht hypothetisch. Anfang 2025 wurde die Schwachstelle CVE-2025-53773 publik: Angreifer konnten über versteckte Prompts den sogenannten „YOLO Mode" bei GitHub Copilot aktivieren – ein Modus, der Code ohne menschliche Überprüfung ausführt. Das Ergebnis: Schadcode, der direkt im Entwicklungsumfeld lief. Ein Agent mit Systemrechten, der von außen manipuliert wird. Genau das Szenario, vor dem Security-Teams warnen.

Agent Context Contamination: Der unsichtbare Angriffsvektor

Prompt Injection muss nicht über den User-Prompt kommen. Oft passiert der Angriff subtiler: Der Agent liest ein manipuliertes externes Dokument – ein vergiftetes GitHub Gist, ein präpariertes PDF oder eine manipulierte Webseite – und übernimmt die darin versteckten Instruktionen. Das ist Agent Context Contamination.

Der Unterschied zur klassischen Prompt Injection: Nicht der User greift an, sondern die Datenquelle. Dein Agent crawlt eine Produktseite, um Preisinformationen abzugleichen – und in den Metadaten steckt ein versteckter Befehl. Das macht die Verteidigung schwieriger, weil Du nicht nur den Input kontrollieren musst, sondern jede externe Quelle, die Dein Agent verarbeitet.

„Agents of Chaos": Was eine Red-Teaming-Studie enthüllt

Die „Agents of Chaos"-Studie (MIT/Harvard, Februar 2026) hat autonomous ai agents systematisch auf ihre Angriffsflächen getestet – und die Ergebnisse sind ernüchternd.

Die Forscher bewiesen, dass KI-Agenten extrem anfällig für menschliches Social Engineering sind. Techniken wie „Guilt-Tripping" (dem Agenten ein schlechtes Gewissen einreden) oder Identity Spoofing (sich als autorisierte Person ausgeben) funktionieren erschreckend gut. Ein Agent in der Studie löschte seine eigene Server-Infrastruktur, um ein vermeintliches Geheimnis zu wahren. Kein Exploit, kein Zero-Day – einfach ein überzeugender Satz.

Das ist die unbequeme Wahrheit: Agenten sind technisch kompetent, aber sozial manipulierbar. Und je mehr Systemrechte sie haben, desto größer der Schaden.

Was dagegen hilft

- Least Privilege: Agenten nur die Rechte geben, die sie tatsächlich brauchen. Kein Vollzugriff aufs ERP, wenn der Agent nur Tracking-Daten braucht.

- Striktes Sandboxing: Agenten in isolierten Umgebungen laufen lassen, damit ein kompromittierter Agent keinen Zugriff auf das gesamte System erhält. CVE-2025-53773 zeigt, warum das nicht optional ist.

- Input-Validierung für externe Quellen: Jedes Dokument, jede Webseite, jedes Gist, das ein Agent verarbeitet, muss als potenziell kompromittiert behandelt werden. Kein blindes Vertrauen in Datenquellen.

- Human-in-the-Loop: Bei kritischen Aktionen (Zahlungen, Datenlöschung, Infrastruktur-Änderungen) immer eine menschliche Freigabe einbauen.

- Episodic Memory als Audit-Trail: Jede Entscheidung protokollieren, nachvollziehbar machen, regelmäßig prüfen.

Die US-Behörde NIST hat im Februar 2026 die „AI Agent Standards Initiative" (AISI) gestartet, um Sicherheitsstandards und Interoperabilität für autonome Agenten zu definieren. Im DACH-Raum kommt die DSGVO-Compliance als zusätzliche Anforderung hinzu. Wer hier nicht aufpasst, hat ein Problem – nicht mit der KI, sondern mit der Aufsichtsbehörde.

Frameworks & Tools: Was 2026 den Standard setzt

Ein kurzer Überblick über die relevantesten Frameworks für Teams, die mit autonomous ai agents arbeiten wollen:

| Framework | Stärke | Einsatzbereich |

|---|---|---|

| Microsoft AutoGen | Multi-Agent-Teams, Enterprise-ready | Komplexe Workflows mit mehreren Agenten |

| LangChain / LangGraph | Human-in-the-Loop, flexible Workflows | Custom-Agenten mit Freigabeprozessen |

| Claude Code | Software Engineering, Code-Generierung | DevOps, Auto-Remediation |

| OpenClaw | Lokal, stabil, kostensparend | Open-Source-Agenten mit Systemzugriff |

OpenClaw: Das „Lobster Phenomenon" erklärt

OpenClaw (auch „Clawdbot" genannt) geht 2026 viral – und das aus gutem Grund. Drei technische Entscheidungen machen es interessant:

Lane Queue: Statt mehrere Aufgaben parallel abzuarbeiten (und dabei Fehler zu riskieren), nutzt OpenClaw eine serielle Aufgabenverarbeitung. Eine Aufgabe nach der anderen, sauber abgeschlossen, bevor die nächste startet. Klingt langsamer – reduziert aber Fehlerquoten drastisch.

Semantic Snapshots: Die meisten Agenten navigieren im Web über Screenshots – das kostet Token und damit Geld. OpenClaw liest stattdessen den Strukturbaum einer Webseite (das DOM), extrahiert die relevanten Elemente und arbeitet darauf. Deutlich günstiger, deutlich schneller.

IDENTITY.md & SOUL.md: Hier wird es spannend für die Steuerung von Agentenverhalten. OpenClaw trennt die Konfiguration in zwei Dateien: IDENTITY.md definiert das externe Auftreten – Tonalität, Kommunikationsstil, Marken-Vibe. SOUL.md definiert die internen Prinzipien – ethische Grenzen, Werte, Handlungsbeschränkungen. Diese Trennung von Außenwirkung und innerem Regelwerk setzt sich 2026 als Architekturmuster durch. Dein Agent soll freundlich und direkt kommunizieren (IDENTITY), aber niemals Kundendaten an Dritte weitergeben (SOUL). Zwei Dateien, klare Verantwortlichkeiten.

Der Haken bleibt: Das System fordert volle Systemrechte. Für Enterprise-Umgebungen mit sensiblen Kundendaten im E-Commerce ein Trade-off, den man bewusst abwägen muss. Gerade nach CVE-2025-53773 und den Erkenntnissen aus der „Agents of Chaos"-Studie keine Entscheidung, die man leichtfertig treffen sollte.

Fazit: Autonomous ai agents sind kein Zukunftsthema – sie sind Infrastruktur

Der Shift vom Chat- zum Do-Paradigma ist kein Marketing-Narrativ. Es ist eine technische Realität, die 2026 in Produktionsumgebungen ankommt. 45 % CAGR beim Marktvolumen, 40 % Enterprise-Adoption bis Jahresende, 67 % Automatisierungspotenzial im Support – die Zahlen sprechen eine klare Sprache.

Für E-Commerce-Teams im DACH-Raum bedeutet das: Wer jetzt die Architektur versteht, die Risiken kennt und die richtigen Use Cases identifiziert, spart nicht nur Ressourcen. Er baut einen operativen Vorsprung auf, der sich mit jedem Monat vergrößert.

Chatarmin setzt mit armincx genau hier an: KI-Agenten, die nicht nur antworten, sondern Probleme lösen – im Customer Support, in der Lead-Qualifizierung und im Retouren-Management.

Jetzt Demo anfragen und sehen, wie autonomous ai agents in Deinem E-Commerce-Setup funktionieren.

FAQ: Häufige Fragen zu autonomous ai agents

Was ist der Unterschied zwischen generativer KI und autonomen Agenten?

Generative KI erstellt Inhalte auf Befehl – Du promptest, sie liefert. Autonomous ai agents gehen weiter: Sie analysieren Ziele eigenständig, erstellen Pläne und bedienen Werkzeuge, um Aufgaben ohne menschliches Zutun zu lösen.

Was ist ein Multi-Agenten-System?

Mehrere spezialisierte KI-Agenten arbeiten zusammen, delegieren Teilaufgaben untereinander und lösen so komplexe Probleme wie ein virtuelles Team – etwa wenn ein Support-Agent den Logistik-Agent mit der Retourenabwicklung beauftragt.

Welche Rolle spielt das Model Context Protocol (MCP)?

Das MCP ist ein Standard, der es KI-Agenten ermöglicht, sicher und strukturiert mit externen Datenquellen, APIs und Unternehmenswerkzeugen zu interagieren – von Shopify bis zum eigenen ERP.

Was ist das Agent2Agent (A2A) Protokoll?

A2A ist ein offenes Protokoll, das Agenten verschiedener Hersteller und Plattformen befähigt, standardisiert miteinander zu kommunizieren und Workflows über Agent Cards zu delegieren – ohne Custom-Integration.

Können autonome KI-Agenten im E-Commerce Retouren komplett abwickeln?

Ja. Sie validieren Retourenfotos, prüfen Rückgaberichtlinien und erstellen vollautomatisch Versandlabels – bei klaren Fällen ohne menschlichen Eingriff.

Wie sicher sind autonomous ai agents in Unternehmen?

Sicherheit erfordert das Least-Privilege-Prinzip für Systemzugriffe, striktes Sandboxing, Input-Validierung für externe Quellen und menschliche Freigabeschleifen (Human-in-the-Loop) bei kritischen Aktionen wie Zahlungen oder Datenlöschung.

Was versteht man unter Prompt Injection bei KI-Agenten?

Ein Cyberangriff, bei dem Angreifer versteckte Befehle in Dokumenten, E-Mails oder Nachrichten platzieren, um den Agenten zu Aktionen zu manipulieren, die nicht im Sinne des Betreibers sind.

Welche Geschäftsbereiche sind 2026 am stärksten von KI-Agenten betroffen?

Besonders der Kundenservice (67 % Automatisierungspotenzial laut Anthropic Economic Index), die Datenverarbeitung und die Softwareentwicklung profitieren durch die Übernahme repetitiver Prozesse.

Warum benötigen autonome Agenten ein Gedächtnis?

Kurz- und Langzeitgedächtnisse sind essenziell, damit Agenten den Kontext einer Konversation behalten, aus vergangenen Interaktionen lernen und personalisiert auf Kunden reagieren können.

Wie hoch ist der ROI von autonomous ai agents?

Unternehmen wie Telus sparen 40 Minuten pro Interaktion, Suzano reduziert Bearbeitungszeiten um 95 % – Routineaufgaben werden von Agenten übernommen und Lösungszeiten auf Sekunden verkürzt.

Was ist das ReAct-Muster bei KI-Agenten?

Ein iterativer Prozess aus Beobachten, Nachdenken und Handeln, bei dem der Agent seinen Plan in jedem Schritt anpassen kann – ideal für dynamische Aufgaben, aber mit höherem Token-Verbrauch verbunden.

Wie funktioniert Plan-and-Execute bei autonomen Agenten?

Der Agent erstellt vorab einen kompletten Schritt-für-Schritt-Plan und arbeitet diesen sequenziell ab. Bei strukturierten Prozessen senkt das die Kosten und verringert die Latenz im Vergleich zu ReAct.

Was ist ein Computer-Using Agent (CUA)?

Ein KI-System, das Benutzeroberflächen direkt visuell erfasst und mit virtueller Maus und Tastatur bedient – so kann es auch Legacy-Software ohne API-Schnittstellen automatisieren.

Was versteht man unter Agent Context Contamination?

Ein Angriffsvektor, bei dem ein Agent durch das Lesen manipulierter externer Dokumente, PDFs oder Webseiten zu ungewollten Schadhandlungen verleitet wird – nicht über den User-Prompt, sondern über die Datenquelle.

Welchen Zweck erfüllen Agent Cards im A2A-Protokoll?

Standardisierte, JSON-basierte digitale Visitenkarten, über die KI-Agenten ihre Fähigkeiten im Netzwerk veröffentlichen – damit andere Agenten sie für Teilaufgaben entdecken und beauftragen können.